人工知能に画像上にレストランのメニューを書き込ませようとしたことのある人なら誰でも、発明された料理、ぐちゃぐちゃの言葉、超現実的な夢から出てきたようなキャラクターなど、それがどのように終わるのかをよく知っています。生成モデルの構造的で、おそらく克服できない限界のように思われていたことは、今や正式に歴史になっています。 OpenAI は、新しいビジュアル生成モデルである ChatGPT Images 2.0 を発表しました。同社によれば、これは、これまでのものと比較して、真の「段階的変化」、つまりパラダイム シフトを表しています。

画像生成器と同じくらい古い技術的問題

なぜこの発表が本当に重要なのかを理解するには、一歩下がって問題の性質に焦点を当てる必要があります。近年の AI 画像生成の基礎となっている拡散モデルは、ランダム ノイズから画像を再構築することで機能します。問題は、書き込みが画像のピクセル全体のほんの一部しか占めていないことです。したがって、モデルは主要な視覚パターンを学習し、テキストを二次的な役割に追いやる傾向があります。デザイナーやコンテンツ作成者がよく知っているように、その結果は、ほとんどの場合、誤字脱字による惨事になります。

Lesan AI の創設者である Asmelash Teka Hadgu 氏が説明したように、システムは最終的にピクセルの大部分をカバーするパターンを学習することになり、テキストは常に背景に残ります。理論的な代替案は自己回帰モデルです。これは、LLM がテキストを処理する方法と同じように画像を考え、画像の各部分がどのように表示されるべきかを予測します。しかし、OpenAI は、Images 2.0 の背後にある正確なアーキテクチャを明らかにすることを望まず、記者会見での質問を拒否しました。重要なのは結果です。問題は、少なくとも最も明白な形では解決されました。

Images 2.0 で本当に変わること

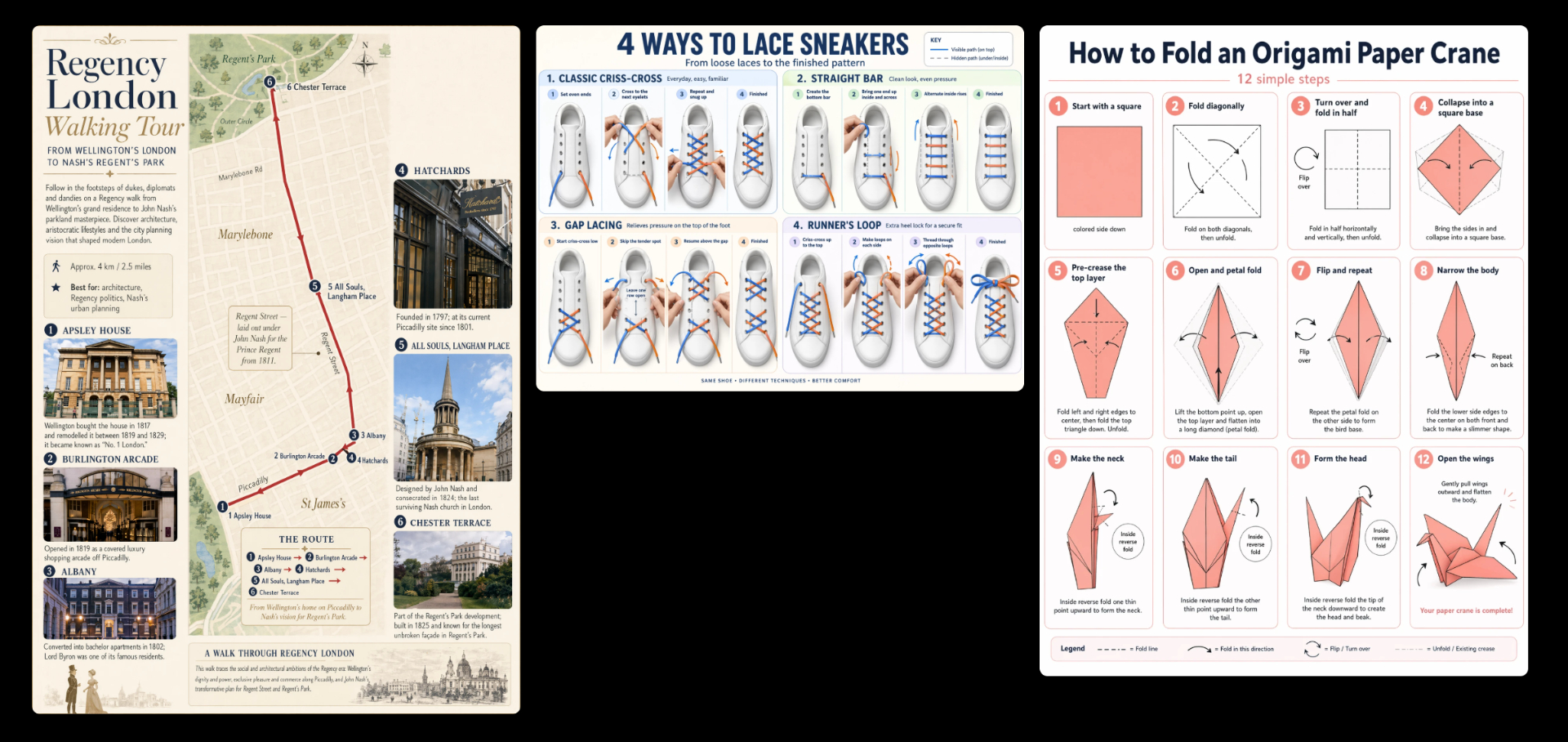

質的な飛躍は、最も要求の厳しいユースケースですぐに顕著になります。このモデルは、以前のバージョンでは到達すらできなかったレベルの忠実度で、小さなテキスト、図像、ユーザー インターフェイス要素、および緻密な視覚的構成をレンダリングできるようになりました。サポートされる最大解像度は 2K に達し、アスペクト比の範囲は 3:1 から 1:3 で、バナー、ポスター、ソーシャル ストーリー、ブックマーク、カバーに便利です。また、単一のステップで同じプロンプトから最大 8 つの個別の出力を取得でき、すべての結果間のスタイルの一貫性を維持できます。

ストーリーボード、ブランド キャンペーン、または一連のソーシャル グラフィックに取り組んでいる人にとって、これにより、これまで一度に 1 つずつ画像を生成して組み立てる必要があり、ほとんどの場合一貫性のない結果が生じていたワークフローが解決されます。 OpenAI は、新しいモデルを真の「ビジュアル ソート パートナー」、つまりリクエストに応じて単一の画像を作成するだけでなく、ビジュアル プロジェクト全体をサポートできるクリエイティブ パートナーとして定義します。

Telegram で人工知能をフォローし、ニュースやオファーを最初に受け取ります

最も重要な新機能: 思考モード

現在利用可能な他のビジュアル ジェネレーターと比較しておそらく最も大きな違いは、推論機能の統合です。 OpenAIがこのモードを導入したのはこれが初めてです 考え、 ビジュアル生成システム内のテキスト モデルのユーザーにはすでに知られています。

この機能をアクティブにすることにより、モデルは Web 上の情報をリアルタイムで検索し、表現されるシーンの構造を推論し、出力の複数のバリエーションを生成し、ユーザーに配信する前にその結果を検証することができます。実際には、モデルは描画する前に「考えます」。入手可能な情報を評価し、それを視覚的に解釈し、単なるプロンプト テキストではなく、実際のコンテキストと一致するものを生成します。論理に対するアプローチの根本的な変更です 「入力を受け取り、画像を生成」 これがこれまでのカテゴリー全体の特徴となっています。

無料プランを含むすべてのプランで利用できる基本モードであるインスタント モードは、以前のモードと比較してすでに大幅な改善が施されています。より強力で高品質の出力を備えた思考モードは、Plus、Pro、Business、Enterprise プランの加入者向けに予約されています。

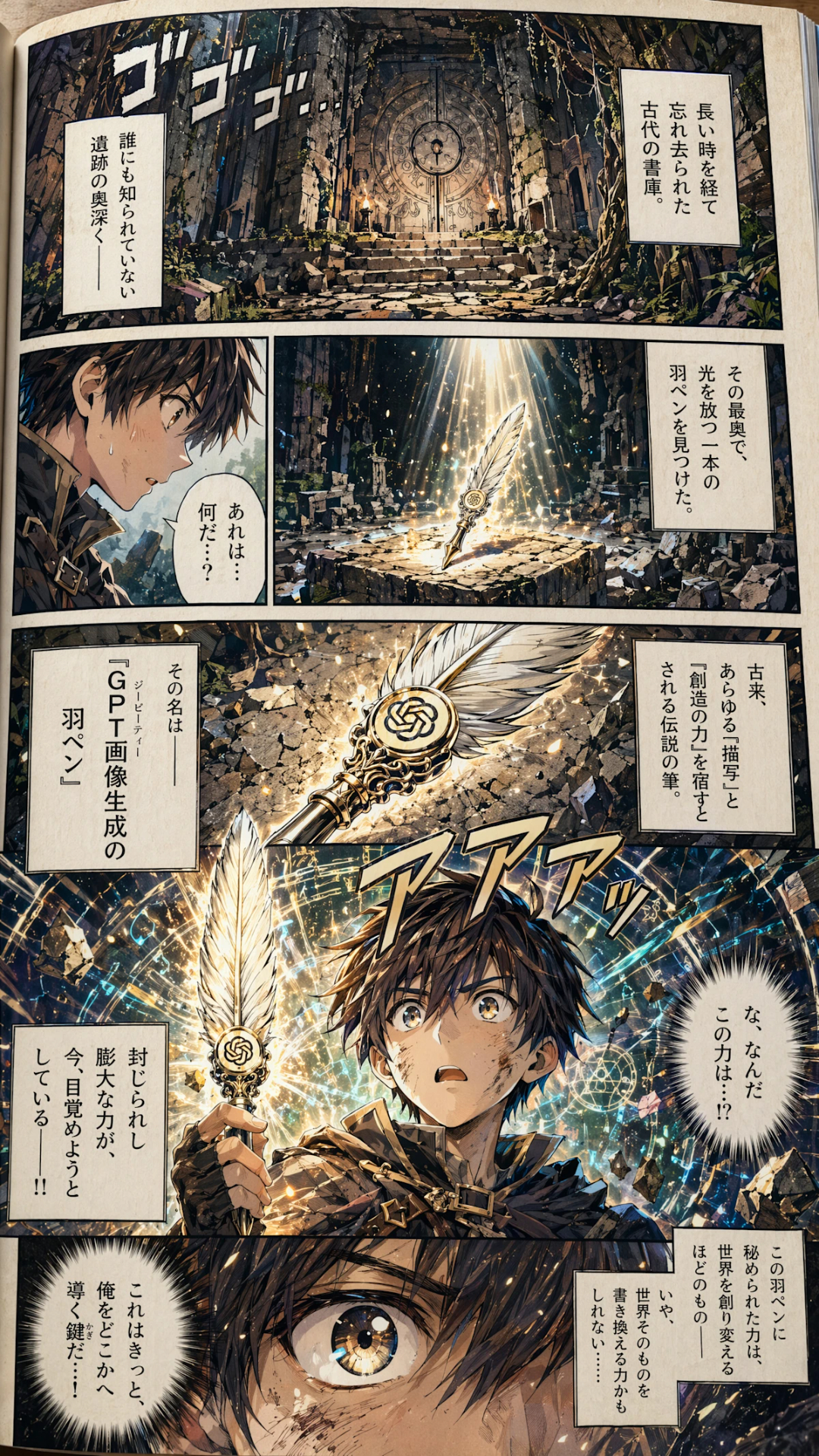

非ラテン語: 市場の開拓

この発表で最も過小評価されている点の 1 つは、非ラテン語のサポートに関するものです。 OpenAI は、日本語、韓国語、中国語、ヒンディー語、ベンガル語のテキストを理解してレンダリングする能力が「大幅に向上」し、これに伴い、これらの各表記体系の視覚的および文化的特性についてのより深い理解が得られたと主張しています。

アジア市場向けの国際コミュニケーション、エディトリアル デザイン、またはアプリ開発に携わる人々にとって、これにより、ローカライズされたポスター、多言語の販促資料、インターフェイスのプロトタイプ、非ラテン文字の会話を含むコミックなど、これまでアクセスできなかった具体的なシナリオが可能になります。 AI によって歪められたすべての単語を修正するために手動のポストプロダクションを行う必要はありません。

スタイル、一貫性、視覚的な忠実度

ChatGPT Images 2.0 は、文体の忠実性の面でも顕著な進歩を示しています。 OpenAI は、このモデルがフォトリアリズム、信じられないほど不完全な写真、映画のフレーム、マンガ、ピクセル アート、その他のアイデンティティ ベースの視覚言語において最も説得力があると説明しています。発売前のテスト中、このモデルは、一貫したビジュアルストーリーテリングを備えた複数ページのマンガシーケンスを生成し、ゲームボーイアドバンスポケモンゲームのアートスタイルを忠実に再現しました。これは、あらゆるビジュアルシステムにとって重要なテストです。

複数の画像間の一貫性は、宣言された目標の 1 つです。つまり、単一のプロンプトによって生成されるさまざまな出力間で同じ文字、同じオブジェクト、同じ視覚スタイルです。シリーズコンテンツを制作する代理店、デジタル編集チーム、クリエイターに対する具体的なニーズ。

可用性とAPIアクセス

このモデルは、すべてのユーザーが ChatGPT、Web、iOS/Android アプリですぐに直接利用できるようになります。開発者は、gpt-image-2 という名前で API 経由でアクセスでき、必要な出力の品質と解像度に基づいて価格が変動します。 OpenAI はまた、コーデックス アプリにもそれを統合しました。コーデックス アプリは先週、画像生成が統合されたアップデートをすでに受け取っていました。

の 知識の遮断 テンプレートは 2025 年 12 月に更新されており、比較的最近の知識を活用しながら、クリエイティブな執筆、分析、グラフィック構成を組み合わせたエンドツーエンドのタスクを処理できるようになりました。

競争環境

この発表は、AI 画像生成市場がますます忙しくなり、より成熟している時期に行われました。数週間前、Anthropic はビジュアルアシスタントの Claude Design を発表しましたが、すでに 2026 年 2 月に Google は画像にテキストを統合する同様の機能を備えた Nano Banana 2 をリリースしました。したがって、OpenAI は激しい競争の中で動き、読みやすいテキストと正確な構成を管理する能力が、主要なビジュアル モデル間の新しい比較分野となっています。

ChatGPT Images 2.0 により、同社は基準を劇的に引き上げました。それは、単に画像を美しくするということではなく、ビジュアル ジェネレーターがまだ提供していなかったレベルの制御と一貫性を備えて推論、調査、計画、生成するシステムです。デザイナー、コンテンツ作成者、デジタル編集スタッフ、開発者にとって、今後数週間の出発点は明らかです。モデルを試し、優れている点とまだ改善の余地がある点を理解し、それをワークフローにインテリジェントに統合します。なぜなら、このステップにより、ビジュアル AI は具体的に新しい段階に入ったからです。