OpenAI ~に対する新しいアプローチを実験している ChatGPT に許可する 見る Androidスマートフォンの画面。目標はいつもと同じで、ユーザーがスマートフォンで行っていることをアシスタントがリアルタイムで分析できるようにすることですが、新しい方法と、パフォーマンスと使用の流動性の点で潜在的な利点が伴います。

今日の仕組み

現在、Android 上の ChatGPT は以下に依存しています。 MediaProjection API 画面のコンテンツにアクセスするには、画面録画アプリケーションや外部ディスプレイに画面を投影する人が使用するのと同じシステムを使用します。

問題は、この方法には一連の不便が伴うことです。許可ウィンドウの重複、ワークフローを中断する警告ポップアップ、そして何よりも記録が継続的に行われるため、システム リソースの大量消費が発生します。

言い換えれば、デバイスの速度が大幅に低下する可能性がある、非常に面倒なエクスペリエンスに直面しているということです。

Telegram で人工知能をフォローし、ニュースやオファーを最初に受け取ります

アクセシビリティとバブル

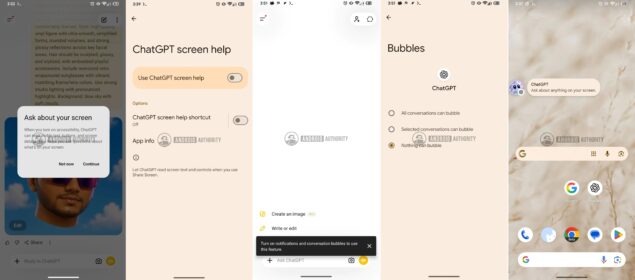

Android 用 ChatGPT アプリのバージョン 1.2026.118 で、一部の研究者は、2 つの非常に異なるツールを使用する開発中の機能を特定しました。 アクセシビリティ Android といわゆる 泡マルチタスク通知バブルは Android 17 で正式に導入されましたが、Android 11 以降では API 経由で利用可能になります。

新しいアプローチでは、関数を初めて開始するときに、ユーザーは呼び出されたエントリを有効にするよう案内されます。 ChatGPT画面ヘルプ システムのアクセシビリティ設定で。次に、通知と会話バブルの許可が要求されます。これは、アプリがオペレーティング システムによって終了されずにバックグラウンドでアクティブな状態を維持するために必要です。以下は、仕事中の斬新な機能のスクリーンショットです。 Android の権限:

ユーザーエクスペリエンスはどう変わるのか

権限が付与されると、インタラクティブなバブルが画面上に表示され (メッセージング チャットのバブルと非常によく似ています)、メイン画面と他のアプリケーション内の両方に表示されたままになります。

このバブルをタップすると、現在画面に表示されている内容について ChatGPT に固有の質問をすることができます。アシスタント 現在のビジュアルコンテキストを独立して分析します、進行中の会話の履歴を引き出すことなく。

このシステムの結果は、現在の方法と比較して興味深い利点があります。 資源の消費量の削減。これは継続的な記録ではなく、ビジュアル コンテンツへの対象を絞ったアクセスであるため、プロセッサとメモリの負荷が大幅に軽減され、ChatGPT を使用している場合でもデバイスの全体的な流動性が向上します。

ただし、アクセシビリティ機能に依存するという選択には、確かに影響がないわけではありません。ここで言及する権限は、実際、Android 上でアプリが要求できる最も詳細な権限の 1 つであり、開いているアプリケーションのテキスト、ボタン、インターフェイスの詳細を読み取ることができるためです。 AI を活用したチャットボットにそれらを委ねることは、実際にどのようなデータがどのように処理されるのか疑問に思い、プライバシーを重視するユーザーを心配させる可能性があります。

何が期待できますか

OpenAI がこれらの懸念にどのように公的に対処する予定であるか、またこの機能がいつ正式にリリースされるかは現時点では不明です。しかし、同社がとった方向性が、この分野におけるますます広範な傾向、つまり、大規模な言語モデルが単純なチャットボットから、ユーザーのデジタル環境内で自律的に動作できるコンテキストアシスタントへと徐々に進化しているという事実を反映していることは確かである。

今後数週間のうちに、同社がデータの管理を重視する人々の信頼を得るのに十分な透明性を持った方法でこれを実現できるかが分かるだろう。